Моделювання нейромережі.

Проектування підсистеми САПР захисту від несанкціонованого доступу

Одним з принципів нейромережевої обробки інформації є висока надійність системи, т.зв. стійкість до відмов у роботі окремих елементів і флуктуацій в рівнях сигналів. Тому логічно припустити, що вдало змодельована нейросеть буде некритична до точності обчислень. Виходячи з цього, я намагався штучно обмежити точність всіх обчислень. Цим пояснюється і вибір типу float для представлення всіх даних… Читати ще >

Моделювання нейромережі. Проектування підсистеми САПР захисту від несанкціонованого доступу (реферат, курсова, диплом, контрольна)

У зв’язку з поділом системи аналізу мови на декілька рівнів (введення, рівень розпізнавання і синтезу слів, рівень смислового контролю), з’явилася можливість моделювати нейросеть окремо для кожного рівня відповідно до вимог з обробки інформації на ньому. Але відмінності в моделях нейромереж я намагався звести до мінімуму, так як такі відмінності не є біологічно виправданими, крім того, при апаратній реалізації системи набагато простіше працювати з однотипними структурами.

Точність обчислень

Одним з принципів нейромережевої обробки інформації є висока надійність системи, т.зв. стійкість до відмов у роботі окремих елементів і флуктуацій в рівнях сигналів. Тому логічно припустити, що вдало змодельована нейросеть буде некритична до точності обчислень. Виходячи з цього, я намагався штучно обмежити точність всіх обчислень. Цим пояснюється і вибір типу float для представлення всіх даних в програмі.

Рівень введення

На цьому рівні при введенні відбувається виділення з сигналу знайомих системі зразків і подання їх одним нейроном або нейронних ансамблем на наступних рівнях. Як при навчанні, так і при розпізнаванні вхідні вектора є нечіткими, тобто є невеликий розкид векторів, що належать до одного класу. У зв’язку з цим нейросеть, що здійснює цю операцію, повинна володіти певною здатністю до статистичного усереднення. Навпаки, може виявитися, що група векторів знаходиться в безпосередній близькості один до одного, але всі вони представляють різні класи. Тоді нейросеть повинна визначати тонкі відмінності між векторами .

Ще одна вимога до нейромережі низького рівня обробки сигналу — навчання без учителя, тобто здатність самостійно розділяти вхідні сигнали на класи .

Велика кількість нейромережевих алгоритмів виконують функцію поділу вхідного сигналу на класи. Схематично мережа зустрічного напрямку зображена на рис. 4.9.

Поширення сигналу у такій мережі відбувається таким чином: вхідний вектор нормується на 1.0 і подається на вхід, який розподіляє його далі через матрицю ваг W. Кожен нейрон в прошарку Кохонена обчислює суму на своєму вході і залежно від стану оточуючих нейронів цього шару стає активним або неактивним (1.0 і 0.0). Нейрони цього шару функціонують за принципом конкуренції, тобто в результаті певної кількості ітерацій активним залишається один нейрон або невелика група. Цей механізм називається латеральним. Так як відпрацювання цього механізму вимагає значних обчислювальних ресурсів, в моїй моделі він замінений знаходженням нейрона з максимальною активністю і присвоєнням йому активності 1.0, а всім іншим нейронам 0.0. Таким чином, спрацьовує нейрон, для якого вектор входу найближче до вектору ваг зв’язків.

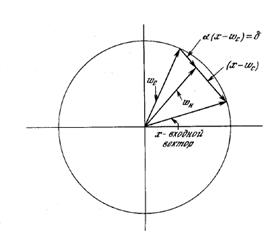

Якщо мережа знаходиться в режимі навчання, то для виграв нейрона відбувається корекція ваг матриці зв’язку за формулою.

w = w + б (x — w) ,.

де w — нове значення ваги ,.

w — старе значення ,.

б — швидкість навчання ,.

х — величина входу.

Геометрично це правило ілюструє рис. 4.10 :

Рисунок 4.10 — Корекція ваг нейрона Кохонена.

Так як вхідний вектор x нормований, тобто розташований на гіперсфері одиничного радіуса в просторі ваг, то при корекції ваг за цим правилом відбувається поворот вектора терезів на бік вхідного сигналу. Поступове зменшення швидкості повороту. дозволяє провести статистичне усереднення вхідних векторів, на які реагує даний нейрон.

Проблема: вибір початкових значень ваг. Так як в кінці навчання вектора ваг будуть розташовуватися на одиничному колі, то на початку їх також бажано отнорміровани на 1.0. У моїй моделі вектора ваг вибираються випадковим чином на колі одиничного радіуса .

Проблема: якщо ваговий вектор виявиться далеко від області вхідних сигналів, він ніколи не дасть найкращої відповідності, завжди буде мати нульовий вихід, отже, не буде коригуватися і виявиться марним. Залишилися ж нейронів може не вистачити для розділення вхідного простору сигналів на класи. Для вирішення цієї проблеми пропонується багато алгоритмів, в моїй роботі застосовується правило" працювати": якщо який або нейрон довго не знаходиться в активному стані, він підвищує ваги зв’язків доти, поки не стане активним і не почне піддаватися навчання. Цей метод дозволяє також вирішити проблему тонкої класифікації: якщо утвориться група вхідних сигналів, розташованих близько один до одного, з цією групою асоціюється і велике число нейронів Кохонена, які розбивають її на класи .

Правило «бажання працювати» записується в такій формі:

.

де w — нове значення ваги,.

w — старе значення,.

? — швидкість модифікації,.

a — активність нейрона.

Чим менше активність нейрона, тим більше збільшуються ваги зв’язків.